당신은 프롬프트 엔지니어링에 대해 들어본 적이 있을지도 모릅니다. 본질적으로, 그것은 '원하는 것을 얻기 위해 인공지능에게 효과적으로 대화하는 것'입니다.

대부분의 사람들은 좋은 프롬프트를 작성하는 방법을 모릅니다.

그러나, 이는 점점 더 중요한 기술이 되고 있습니다...

왜냐하면, 쓰레기 인 데이터 = 쓰레기 아웃 결과가 되기 때문입니다.

이곳에는 프롬프트에 필요한 가장 중요한 기술들이 있습니다.👇

저는 언어 모델을 'LM'으로 참조하겠습니다.

언어 모델의 예시는 @OpenAI의 ChatGPT와 @AnthropicAI의 Claude입니다.

1. 개인 정보/역할 유도

인공지능에 역할을 부여합니다.

예시: "당신은 X에 대한 전문가입니다. 20년 동안 사람들이 Y를 하는 데 도움을 주었습니다. 당신의 역할은 X에 관한 최고의 조언을 제공하는 것입니다.

이해했다면 '알겠습니다'라고 답변해주세요."

다음은 강력한 추가 기능입니다:

‘질문에 대답하기 전에 항상 질문을 먼저 하여 질문자가 무엇을 찾고 있는지 더 잘 이해할 수 있어야 합니다.’

곧 중요한 이유에 대해 이야기하겠습니다.

2. 감시 및 치료원

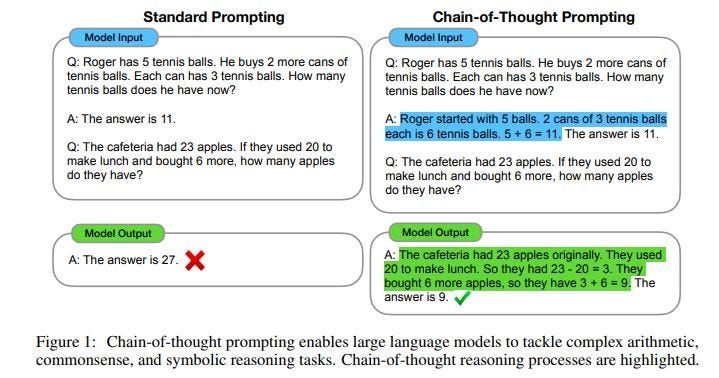

CoT는 ‘생각의 연속’을 의미합니다.

이는 LM에게 추론 과정을 설명하도록 지시하는 데 사용됩니다.

예시:

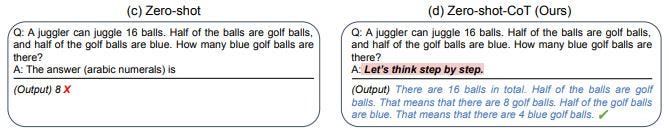

3. 제로샷-컴피티션타임

제로샷은 모델이 프롬프트 내에서 추가적인 훈련 없이 예측을 수행하는 것을 의미합니다.

곧 샷 몇 개로 이동할 것입니다.

일반적으로 CoT 값이 Zero-shot-CoT 값보다 큽니다.

예시:

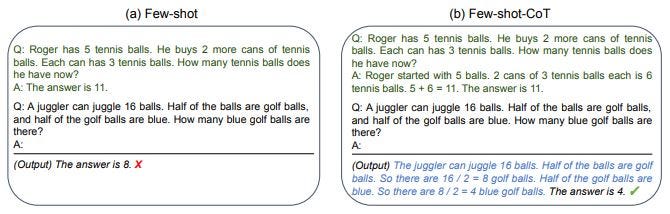

4. Few-shot (그리고 few-shot-CoT)

퓨샷은 LM (언어 모델) 가 프롬프트에 몇 가지 예제를 제공받아 새로운 예제에 더 빨리 적응할 수 있도록 하는 것입니다.

예시:

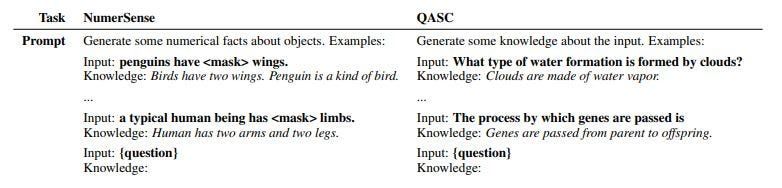

5. 지식 생성

LM를 독려하여 질문과 관련된 지식을 생성합니다.

이는 생성된 지식 프롬프트에 사용할 수 있습니다 (자세한 내용은 아래 참조).

예시:

6. 생성된 지식

이제 우리는 지식을 갖고 있으므로, 이 정보를 새로운 프롬프트에 넣고 그에 관련된 질문을 할 수 있습니다.

그런 질문을 '지식 증강' 질문이라고 부릅니다.

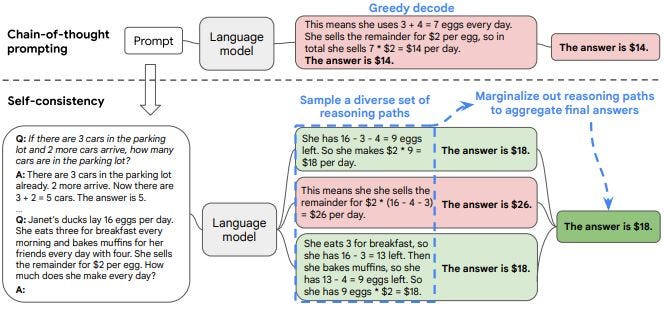

7. 자기일관성

이 기술은 여러 가지 추론 경로 (사고의 연결)를 생성하는 데 사용됩니다.

다수의 응답이 최종 답안으로 선택됩니다.

예시:

8. 형중

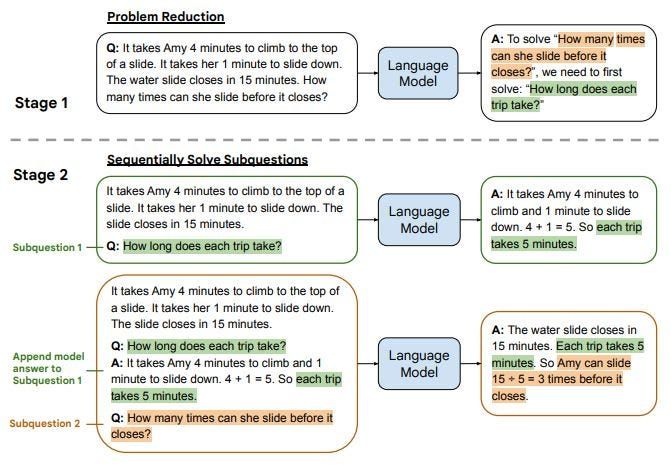

LtM는 '최소부터 최대까지'를 의미합니다.

이 기술은 CoT의 연장선상에 있습니다. 또한, 이는 문제를 하위 문제로 분할하여 그것들을 해결함으로써 작동합니다.

예시: